MASSACHUSETTS, EU.- Hasta la fecha, los sistemas basados en inteligencia artificial se centran en encontrar soluciones y automatizar procesos con el objetivo de contribuir, en su escala, a una situación mejor para el ser humano. Los hemos visto aplicados en el tratamiento de enfermedades o incluso para evitar colas en los WC públicos, pero… ¿Y si el sistema está programado para el mal? Este planteamiento lo ha llevado a la realidad un grupo de investigadores del prestigioso Instituto de Tecnología de Massachusetts (MIT), publicó El País.

El equipo, formado por Pinar Yanardag, Manuel Cebrián e Iyad Rahwan, ha creado un asistente virtual que únicamente se nutre de información negativa y tenebrosa de la Red, con el único objetivo de conocer cómo actuaría el sistema empleando esta visión de las cosas. Todos hemos tenido alguna vez un mal día en el que todo parece salirnos mal y nuestra visión de las cosas es siempre negativa; pues bien, este sería el estado natural de este sistema al que han bautizado como Norman.

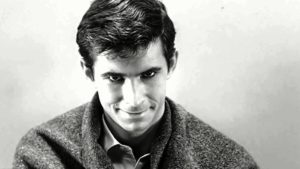

FOTO: Norman Bates, interpretado por Anthony Perkins, en ‘Psicosis’.

La elección del nombre no es baladí: responde al siniestro personaje Norman Bates del film Psicosis que ha atemorizado a varias generaciones, y en cierto sentido, las semejanzas entre ambos caracteres son llamativas. Este equipo del MIT ha creado un algoritmo que se nutre de información proveniente de los rincones más oscuros del conocido foro Reddit. Norman acumula de forma masiva terminología, expresiones, pero también material gráfico de carácter perturbador con el objetivo de crear una personalidad propia que apunta maneras.

Tras varios días recopilando datos, al asistente basado en inteligencia artificial se le sometió al conocido test de Rorschach, aquel en el que se muestran unos dibujos sin un contenido claro de forma que el cerebro del paciente componga la estampa en función de sus pensamientos. El resultado fue demoledor. “Norman identificó imágenes aterradoras y en todas ellas estaba la presencia de la muerte”, confirman los responsables del estudio a CNN.

Así, por ejemplo, en la primera imagen mostrada aparecía un grupo de pájaros posados sobre la rama de un árbol, una información gráfica que este asistente identificó como un hombre electrocutado. De hecho, en todas las imágenes que mostraban la presencia de un ser humano, éste era objeto de asesinato o aparecía la muerte en alguno de los elementos de su justificación. Pero… ¿por qué ha creado el MIT un asistente tan cargado de odio?

El equipo ha querido concienciar al mundo del potencial peligro de los sistemas basados en inteligencia artificial, una visión compartida y alertada desde hace tiempo por figuras relevantes como Elon Musk. Este equipo advierte que estos sistemas sin control pueden ser muy perjudiciales y, en clara semejanza a las corrientes de opinión que pueden generarse en la sociedad empleando bots, si asistentes como Norman se alimentan exclusivamente de negatividad, esto es lo que proyectarán y aplicarán.

Pero no está todo perdido para este asistente y los que vengan después: los expertos explican que la visión negativa del sistema puede reconducirse de forma automática si se le expone a una visión más positiva de las cosas. (Fuente: El País)